Para sa BMS, BUS, Industrial, Instrumentation Cable.

Opisyal na inilunsad ni Elon Musk at ng xAI team ang pinakabagong bersyon ng Grok, Grok3, sa isang livestream. Bago ang kaganapang ito, ang malaking halaga ng nauugnay na impormasyon, kasama ang 24/7 na promosyonal na hype ng Musk, ay nagpapataas ng pandaigdigang mga inaasahan para sa Grok3 sa mga hindi pa nagagawang antas. Isang linggo lang ang nakalipas, kumpiyansa na sinabi ni Musk sa isang livestream habang nagkomento sa DeepSeek R1, "maglalabas na ang xAI ng mas magandang modelo ng AI." Mula sa data na ipinakita nang live, ang Grok3 ay naiulat na nalampasan ang lahat ng kasalukuyang pangunahing mga modelo sa mga benchmark para sa matematika, agham, at programming, kung saan sinasabi pa ni Musk na ang Grok3 ay gagamitin para sa mga computational na gawain na nauugnay sa mga misyon ng SpaceX sa Mars, na hinuhulaan ang "mga tagumpay sa antas ng Nobel Prize sa loob ng tatlong taon." Gayunpaman, ang mga ito ay kasalukuyang mga pahayag lamang ni Musk. Pagkatapos ng paglunsad, sinubukan ko ang pinakabagong beta na bersyon ng Grok3 at ibinahagi ang klasikong tanong ng trick para sa malalaking modelo: "Alin ang mas malaki, 9.11 o 9.9?" Sa kasamaang palad, nang walang anumang mga kwalipikasyon o marka, ang tinaguriang pinakamatalino na Grok3 ay hindi pa rin masagot ng tama ang tanong na ito. Nabigo ang Grok3 na tumpak na tukuyin ang kahulugan ng tanong.

Ang pagsusulit na ito ay mabilis na nakakuha ng malaking atensyon mula sa maraming mga kaibigan, at nagkataon, ang iba't ibang mga katulad na pagsusulit sa ibang bansa ay nagpakita ng Grok3 na nahihirapan sa mga pangunahing tanong sa pisika/matematika tulad ng "Aling bola ang unang mahuhulog mula sa Leaning Tower ng Pisa?" Kaya, ito ay binansagan bilang "isang henyo na ayaw sumagot ng mga simpleng tanong."

Maganda ang Grok3, ngunit hindi ito mas mahusay kaysa sa R1 o o1-Pro.

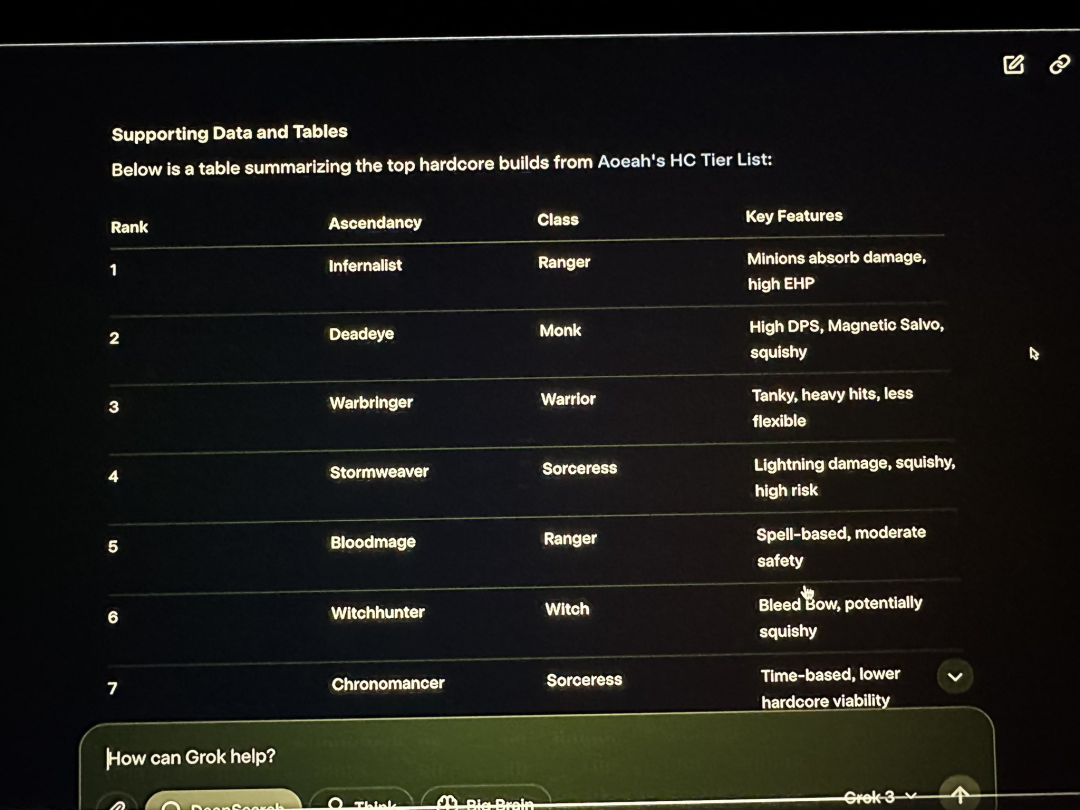

Nakaranas ang Grok3 ng "mga pagkabigo" sa maraming pagsusulit sa karaniwang kaalaman sa pagsasanay. Sa panahon ng kaganapan sa paglulunsad ng xAI, ipinakita ng Musk ang paggamit ng Grok3 upang suriin ang mga klase ng character at mga epekto mula sa larong Path of Exile 2, na inaangkin niyang madalas niyang nilalaro, ngunit ang karamihan sa mga sagot na ibinigay ng Grok3 ay hindi tama. Ang musk sa panahon ng livestream ay hindi napansin ang halatang isyu na ito.

Ang pagkakamaling ito ay hindi lamang nagbigay ng karagdagang katibayan para sa mga netizens sa ibang bansa upang kutyain si Musk para sa "paghahanap ng kapalit" sa paglalaro ngunit nagtaas din ng mga makabuluhang alalahanin tungkol sa pagiging maaasahan ng Grok3 sa mga praktikal na aplikasyon. Para sa gayong "henyo," anuman ang aktwal na mga kakayahan nito, ang pagiging maaasahan nito sa mga napakasalimuot na sitwasyon ng aplikasyon, tulad ng mga gawain sa pagsaliksik sa Mars, ay nananatiling may pagdududa.

Sa kasalukuyan, maraming tester na nakatanggap ng access sa Grok3 linggo na ang nakalipas, at ang mga sumubok lang sa mga kakayahan ng modelo sa loob ng ilang oras kahapon, lahat ay tumuturo sa isang karaniwang konklusyon: "Maganda ang Grok3, ngunit hindi ito mas mahusay kaysa sa R1 o o1-Pro."

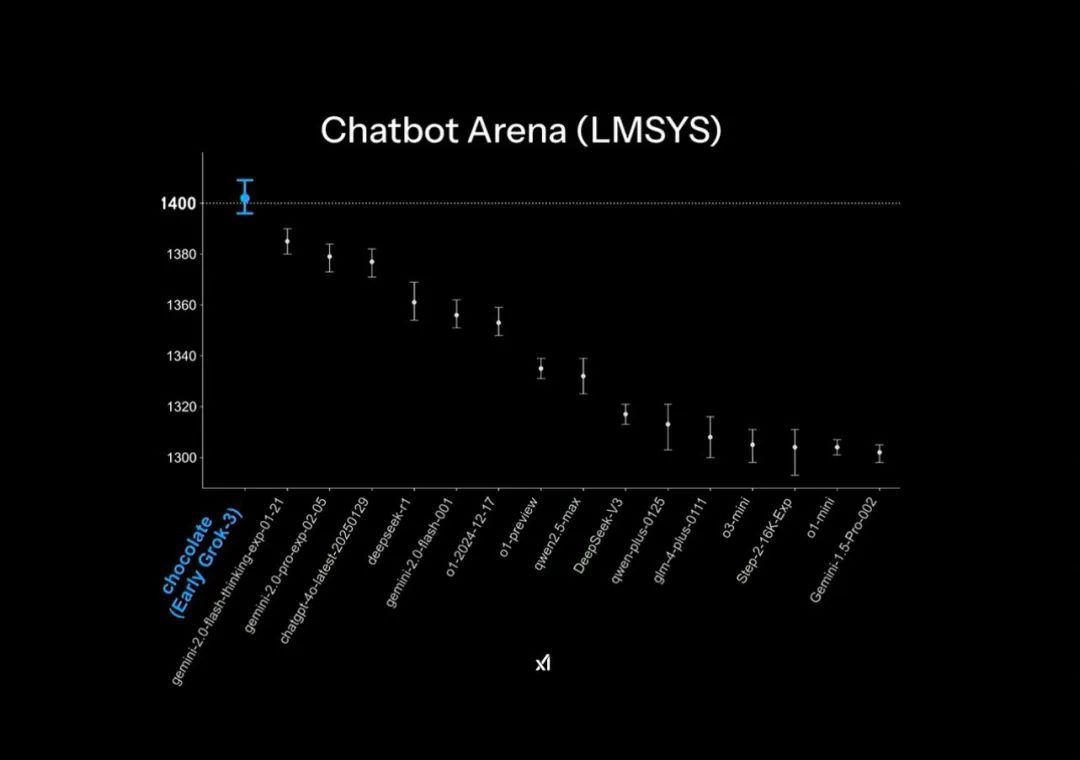

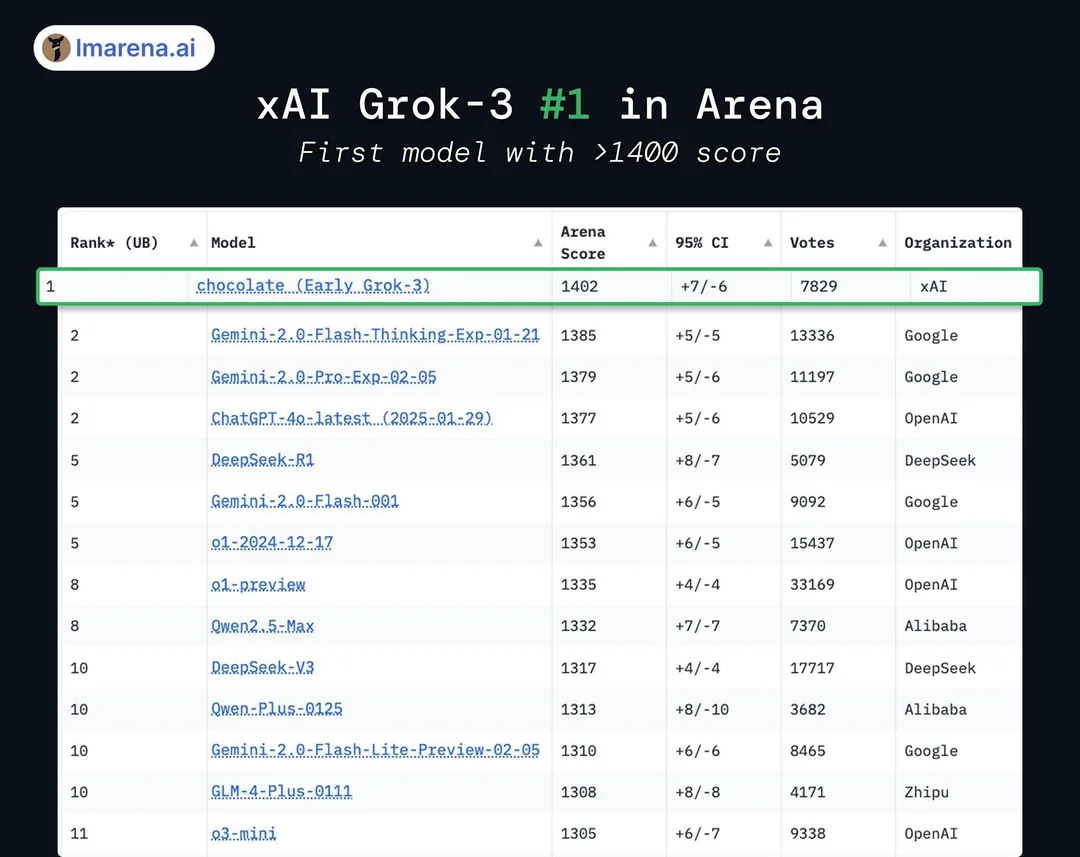

Isang Kritikal na Pananaw sa "Paggambala sa Nvidia"

Sa opisyal na iniharap na PPT sa panahon ng paglabas, ipinakita ang Grok3 na "malayo sa unahan" sa Chatbot Arena, ngunit ang matalinong paggamit ng mga graphic na diskarteng ito: ang vertical axis sa leaderboard ay naglista lamang ng mga resulta sa hanay ng mga marka na 1400-1300, na ginagawang ang orihinal na 1% na pagkakaiba sa mga resulta ng pagsubok ay mukhang lubhang makabuluhan sa presentasyong ito.

Sa aktwal na mga resulta ng pagmamarka ng modelo, ang Grok3 ay nauuna lamang ng 1-2% kaysa sa DeepSeek R1 at GPT-4.0, na tumutugma sa mga karanasan ng maraming user sa mga praktikal na pagsubok na nakakita ng "walang kapansin-pansing pagkakaiba." Lumalampas lamang ang Grok3 sa mga kahalili nito ng 1%-2%.

Bagama't ang Grok3 ay nakakuha ng mas mataas kaysa sa lahat ng kasalukuyang nasubok sa publiko na mga modelo, marami ang hindi sineseryoso ito: pagkatapos ng lahat, ang xAI ay dati nang binatikos para sa "pagmamanipula ng marka" sa panahon ng Grok2. Habang pinarusahan ng leaderboard ang istilo ng haba ng sagot, ang mga marka ay lubhang nabawasan, na humahantong sa mga tagaloob ng industriya na madalas na pumuna sa kababalaghan ng "mataas na pagmamarka ngunit mababang kakayahan."

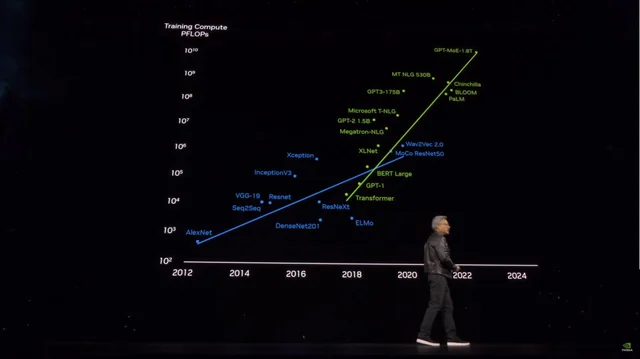

Sa pamamagitan man ng "manipulasyon" ng leaderboard o mga trick sa disenyo sa mga ilustrasyon, ipinapakita nila ang pagkahumaling ng xAI at Musk sa paniwala ng "nangunguna sa grupo" sa mga kakayahan ng modelo. Mataas na presyo ang binayaran ni Musk para sa mga margin na ito: sa panahon ng paglulunsad, ipinagmalaki niya ang paggamit ng 200,000 H100 GPU (nag-claim na "mahigit sa 100,000" sa livestream) at naabot ang kabuuang oras ng pagsasanay na 200 milyong oras. Naging dahilan ito upang maniwala ang ilan na ito ay kumakatawan sa isa pang makabuluhang biyaya para sa industriya ng GPU at isaalang-alang ang epekto ng DeepSeek sa sektor bilang "hangal." Kapansin-pansin, ang ilan ay naniniwala na ang manipis na computational power ang magiging kinabukasan ng model training.

Gayunpaman, inihambing ng ilang netizens ang pagkonsumo ng 2000 H800 GPU sa loob ng dalawang buwan upang makagawa ng DeepSeek V3, na kinakalkula na ang aktwal na pagkonsumo ng kuryente ng Grok3 ay 263 beses kaysa sa V3. Ang agwat sa pagitan ng DeepSeek V3, na nakakuha ng 1402 puntos, at Grok3 ay mas mababa sa 100 puntos. Kasunod ng paglabas ng data na ito, mabilis na napagtanto ng marami na sa likod ng pamagat ng Grok3 bilang "pinakamalakas sa mundo" ay mayroong malinaw na marginal utility effect—ang lohika ng mas malalaking modelo na bumubuo ng mas malakas na pagganap ay nagsimulang magpakita ng lumiliit na mga kita.

Kahit na may "mataas na marka ngunit mababa ang kakayahan," ang Grok2 ay may napakaraming mataas na kalidad na data ng first-party mula sa X (Twitter) platform upang suportahan ang paggamit. Gayunpaman, sa pagsasanay ng Grok3, natural na nakatagpo ng xAI ang "ceiling" na kasalukuyang kinakaharap ng OpenAI—ang kakulangan ng premium na data ng pagsasanay ay mabilis na inilalantad ang marginal utility ng mga kakayahan ng modelo.

Ang mga developer ng Grok3 at Musk ay malamang na ang unang nauunawaan at natukoy ang mga katotohanang ito nang malalim, kaya naman patuloy na binanggit ni Musk sa social media na ang bersyon na nararanasan ngayon ng mga user ay "beta pa rin" at "ang buong bersyon ay ilalabas sa mga darating na buwan." Ginampanan ng Musk ang tungkulin ng tagapamahala ng produkto ng Grok3, na nagmumungkahi na ang mga user ay magbigay ng feedback sa iba't ibang isyung nakatagpo sa seksyon ng mga komento. Maaaring siya ang pinakasinusundan na tagapamahala ng produkto sa Earth.

Gayunpaman, sa loob ng isang araw, ang pagganap ng Grok3 ay walang alinlangan na nagtaas ng mga alarma para sa mga umaasa na umasa sa "massive computational muscle" upang sanayin ang mas malalakas na malalaking modelo: batay sa pampublikong magagamit na impormasyon ng Microsoft, ang OpenAI's GPT-4 ay may sukat ng parameter na 1.8 trilyong parameter, higit sampung beses kaysa sa GPT-3. Iminumungkahi ng mga alingawngaw na ang laki ng parameter ng GPT-4.5 ay maaaring mas malaki pa.

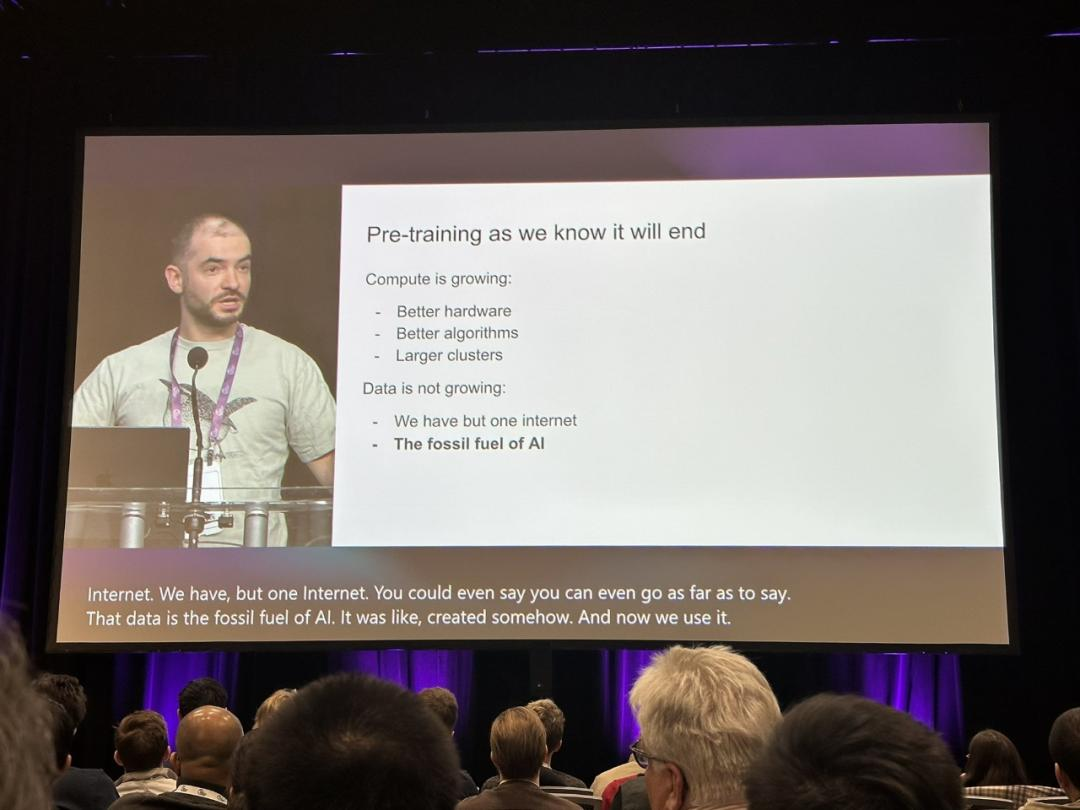

Habang tumataas ang laki ng parameter ng modelo, ang mga gastos sa pagsasanay ay tumataas din. Sa presensya ng Grok3, dapat isaalang-alang ng mga contenders tulad ng GPT-4.5 at iba pa na gustong magpatuloy sa "pagsunog ng pera" upang makamit ang mas mahusay na pagganap ng modelo sa pamamagitan ng laki ng parameter na dapat isaalang-alang ang kisame na ngayon ay malinaw na nakikita at pag-isipan kung paano ito malalampasan. Sa sandaling ito, si Ilya Sutskever, dating punong siyentipiko sa OpenAI, ay nagsabi noong nakaraang Disyembre, "Ang pre-training na pamilyar sa atin ay magtatapos," na muling lumitaw sa mga talakayan, na nag-udyok sa mga pagsisikap na mahanap ang totoong landas para sa pagsasanay ng malalaking modelo.

Ang pananaw ni Ilya ay naging alarma sa industriya. Tumpak niyang nakita ang nalalapit na pagkaubos ng naa-access na bagong data, na humahantong sa isang sitwasyon kung saan ang pagganap ay hindi maaaring patuloy na mapahusay sa pamamagitan ng pagkuha ng data, na inihahalintulad ito sa pagkaubos ng fossil fuels. Ipinahiwatig niya na "tulad ng langis, ang nilalamang nabuo ng tao sa internet ay isang limitadong mapagkukunan." Sa mga hula ni Sutskever, ang susunod na henerasyon ng mga modelo, post-pre-training, ay magkakaroon ng "tunay na awtonomiya" at mga kakayahan sa pangangatwiran "katulad ng utak ng tao."

Hindi tulad ng mga pre-trained na modelo ngayon na pangunahing umaasa sa pagtutugma ng nilalaman (batay sa dating natutunang nilalaman ng modelo), ang mga hinaharap na AI system ay makakatuto at makakapagtatag ng mga pamamaraan upang malutas ang mga problema sa paraang katulad ng "pag-iisip" ng utak ng tao. Ang isang tao ay maaaring makamit ang pangunahing kasanayan sa isang paksa gamit lamang ang pangunahing propesyonal na literatura, habang ang isang malaking modelo ng AI ay nangangailangan ng milyun-milyong puntos ng data upang makamit lamang ang pinakapangunahing entry-level na kahusayan. Kahit na bahagyang binago ang mga salita, ang mga pangunahing tanong na ito ay maaaring hindi maunawaan nang tama, na naglalarawan na ang modelo ay hindi tunay na napabuti sa katalinuhan: ang mga pangunahing ngunit hindi malulutas na tanong na binanggit sa simula ng artikulo ay kumakatawan sa isang malinaw na halimbawa ng hindi pangkaraniwang bagay na ito.

Konklusyon

Gayunpaman, sa kabila ng malupit na puwersa, kung talagang magtatagumpay ang Grok3 sa paghahayag sa industriya na "papalapit na ang mga pre-trained na modelo sa kanilang katapusan," magkakaroon ito ng makabuluhang implikasyon para sa larangan.

Marahil pagkatapos na unti-unting humupa ang kaguluhang nakapalibot sa Grok3, masasaksihan natin ang higit pang mga kaso tulad ng halimbawa ni Fei-Fei Li ng "pag-tune ng mga high-performance na modelo sa isang partikular na dataset sa halagang $50 lang," sa huli ay matutuklasan ang totoong landas patungo sa AGI.

Mga Kable ng Kontrol

Structured Cabling System

Network at Data, Fiber-Optic Cable, Patch Cord, Mga Module, Faceplate

Abr.16-18, 2024 Middle-East-Energy sa Dubai

Abr.16-18, 2024 Securika sa Moscow

Ika-9 ng Mayo, 2024 MGA BAGONG PRODUKTO at TEKNOLOHIYA NA LUNSAD NA EVENT sa Shanghai

Okt.22-25, 2024 SECURITY CHINA sa Beijing

Nob.19-20, 2024 KONEKTADO MUNDO KSA

Oras ng post: Peb-19-2025